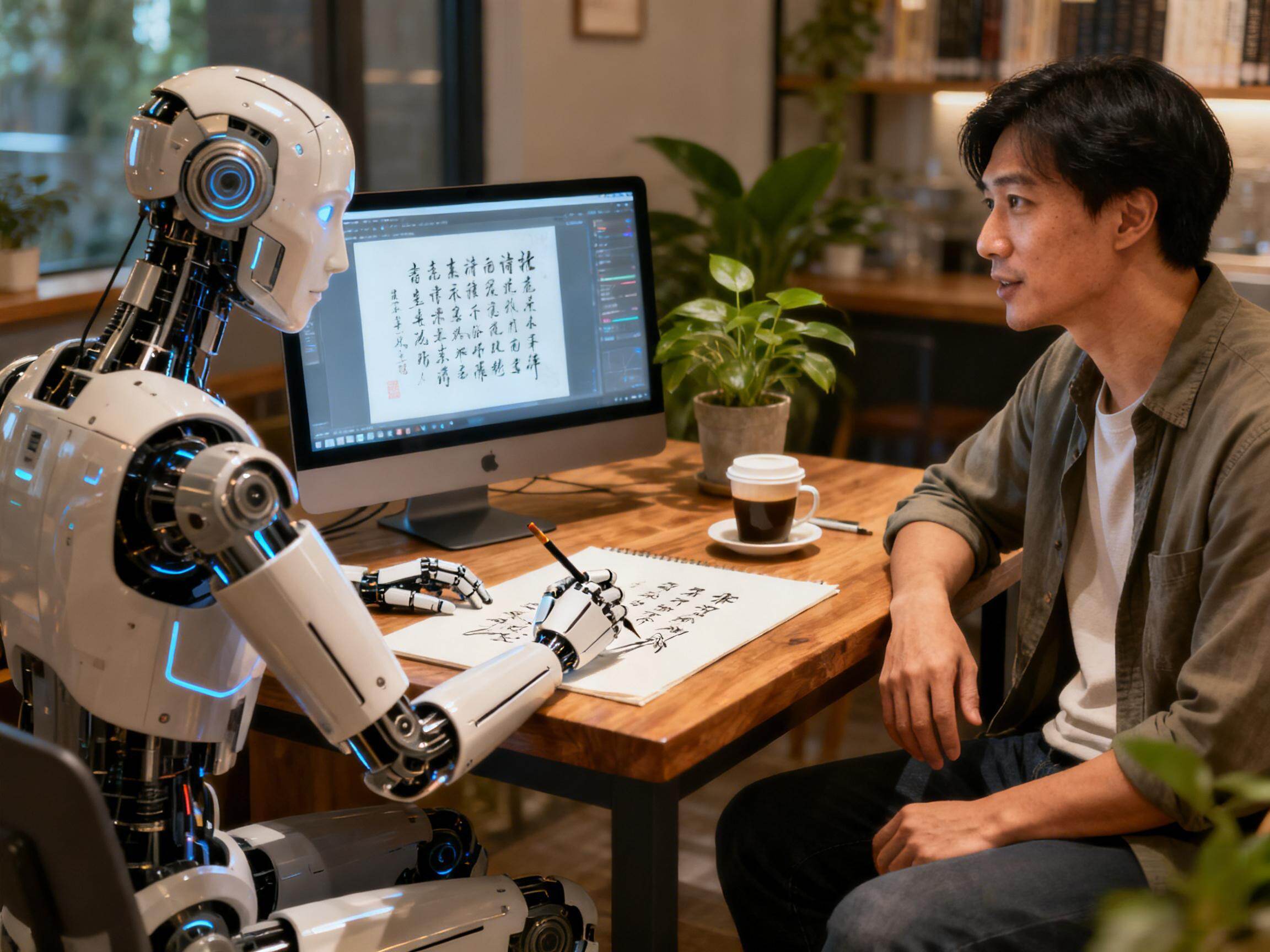

这些年,人工智能技术的发展速度超出了许多人的想象。从能够写诗作画的程序,到可以和人自然对话的助手,AI似乎正在一步步接近我们。于是,一个老问题又被频繁提起:AI离真正成为“人”,到底还有多远?

国内的科研团队在这个领域不断探索,也取得了一些新的进展。比如,他们研发的新技术,让AI在某种程度上实现了像人一样形成概念,甚至进行简单的概念交流。这听起来很令人振奋,仿佛科幻电影里的场景正在变成现实。然而,真正站在研究第一线的科研人员,对此却有着冷静甚至谨慎的看法。他们认为,虽然技术上有了突破,但在AI和人之间,仍然横亘着几条难以在短期内跨越的鸿沟,想要实现“类人完整智能”,还是一件非常遥远的事情。

那么,这些难以逾越的鸿沟到底是什么?我们不妨一层层剥开来看。

第一层区别:模拟与拥有,本质上的不同

一个最核心的区别在于,AI所展现出来的所有类人行为,本质上都是一种精密的“模拟”,而不是真正的“拥有”。

举个例子,当你向一个AI助手提问,它能给你一个条理清晰、信息准确的回答。这个过程中,它可能表现得像一个知识渊博的学者。但学者回答问题,是基于对知识的理解,对问题背后需求的分析,甚至包含了他希望传递某种观点或情感的意图。而AI的回答,则是根据你输入的问题,在它庞大的数据库里进行搜索、匹配、组合,最终生成一个最符合语言逻辑的答案。它并不知道这个答案意味着什么,也不关心你是否真的理解了,更谈不上有任何想要帮助你或与你交流的情感驱动。

同样,新技术能让AI提炼和传递概念。比如,给它看许多张猫的图片,它能总结出“猫”这个概念,并且在看到一张新图片时,准确地认出这是一只猫。当另一个AI系统接收到这个概念后,也能理解并运用。这个过程,看起来就像两个人在交流“猫是什么”。但研究者指出,AI做这件事,只是为了完成一项被设定的“任务”。它需要从图片中提取特征,形成规则,然后应用规则。至于猫这种动物可爱不可爱,为什么人类喜欢养猫,猫在文化中有什么象征意义,这些与概念紧密相连的情感、文化和经验层面的东西,AI是一无所知的。它像一个极其勤奋的学生,完美地完成了作业,却从未体会过知识本身的乐趣和意义。人类形成概念,是为了理解世界、表达情感、与他人建立连接,而AI形成概念,仅仅是为了运行程序。

第二层区别:智能的核心,综合与灵活的差距

人类智能的核心优势之一,在于它的综合性与灵活性。我们的大脑不是一个单一功能的处理器,而是一个极其复杂的、各部分紧密协同工作的系统。

当你在一个陌生的城市迷路时,你需要调动视觉能力去看路牌和建筑,调动记忆能力回想走过的路线,调动空间感知能力去判断方位,可能还需要调动语言能力去向路人求助,同时你的情绪(焦虑、着急)也会参与其中,影响你的决策。所有这些能力综合在一起,才构成了你“找到路”这个智能行为。

而目前的AI,包括那些取得了突破性进展的模型,其智能往往是“单一”且“孤立”的。一个专门处理视觉任务的AI,可能在识别图像方面超越人类,但它无法将“看到一只猫”这件事,与“猫是一种温顺的宠物”这种知识联系起来,更无法联想到自己童年时养过的一只猫,以及与之相关的温馨或悲伤的记忆。因为它没有情感,没有记忆,也没有亲身经历过的经验。研究者也指出,新技术虽然实现了概念层面的突破,但依然被局限在视觉感知这个单一任务里。它提炼出的概念,是视觉特征的高度抽象,无法像人类一样,将概念与情感、记忆、经验进行深度融合,形成一个丰富多彩、相互关联的认知网络。这种将不同信息、不同能力融会贯通,并根据实际情况灵活运用的能力,正是当前AI难以企及的高峰。

第三层区别:成长的方式,预设与发展的不同

人类的智能具有天然的成长性和适应性。一个孩子从出生开始,就在不断地学习和成长。他的成长不是被预设好的程序。他会在玩耍中探索世界,在摔倒中学会走路,在犯错中明白道理,在与人的交往中理解社会规则。每一次新的经历,无论是成功还是失败,都会被他吸收,成为下一次决策的依据。他是在与环境、与他人持续不断的互动中,主动地、自主地构建和发展自己的智能。

AI的“智能”则完全是另一条路径。它的能力是由开发者预设的算法和海量的训练数据赋予的。在训练阶段,它像一个在海量书籍里“学习”如何写文章的学生,学成之后,它可以写出通顺的文章,但如果你问它一个书中从未出现过的新问题,它就很可能答非所问,甚至给出完全错误的答案。它无法像人类一样,在经历了一次失败后,自己进行反思,总结经验教训,然后调整下一次的策略。它的“成长”是被动的,依赖于开发者给它投喂新的数据和更新算法。一旦超出它被训练的那个范围和场景,它的表现就可能出现大幅度的滑坡。这种依靠外部力量“升级”和从内部主动“成长”的区别,是决定AI能否真正独立面对复杂多变世界的根本差异。

第四层区别:价值的判断,无法复制的伦理

人类的行为,无时无刻不受着价值观和伦理判断的指引。在公共汽车上,你会把座位让给需要帮助的人,是因为你内心有“尊老爱幼”的道德观念。在工作中,你会诚实地完成自己的任务,是因为你认为“诚实守信”是做人的基本准则。这些价值观不是写在纸上的教条,而是融入我们血液里的行为准则,指导我们在面对复杂情境时,做出符合社会期待的选择。

而AI,从根本上说,没有价值观,也不具备伦理判断的能力。它的所有决策,都基于数据和算法给出的最优解。这个“最优解”可能是效率最高、成本最低、成功率最大,但它完全不涉及“对”与“错”、“善”与“恶”的考量。一个由AI控制的自动驾驶汽车,在遇到突发事故时,可能会计算出“撞向人数较少的一边”是最优解,但这个选择背后的伦理困境和生命价值权衡,它是无法理解和承担的。

如何让AI的行为准则与人类的价值观保持一致,也就是所谓的“价值对齐”,是当前和未来人工智能领域最核心、最困难的难题之一。我们需要教会AI什么是公平,什么是正义,什么是尊重生命。但问题是,我们自己有时候对这些问题都没有统一的答案,又该如何把这些复杂甚至充满矛盾的伦理观念,编码成机器可以理解和执行的规则呢?

现如今AI在模仿人类智能的某些特定方面,已经取得了令人瞩目的成就。它能写诗、作画、下棋、看病,甚至开始学习形成和传递概念。这些进步,让我们看到了技术的无限潜力。但是,从“像人”到真正“成为人”,中间还隔着无数道天堑。

AI没有情感,无法体会喜怒哀乐;AI没有自我意识,无法感知“我”的存在;AI没有主观体验,无法理解一朵花的香味、一首歌的感动、一次拥抱的温暖。它缺乏成长的动力,没有反思的能力,更无法拥有基于文化和历史沉淀下来的价值观。

研究者们的看法是清醒而深刻的。要让AI真正成为“人”,我们必须突破自我意识、情感感知、综合认知等一系列核心难题。这些难题,每一个都指向人类智能最神秘、最核心的部分。或许在未来,AI能在越来越多的领域模拟人类的行为,成为我们生活中无处不在的、极其有用的工具和伙伴。但它是否能像我们一样,拥有内在的意识和主观的体验,拥有一个鲜活的、会哭会笑的“灵魂”?这个问题,至今没有答案。而这,或许也正是人类智能最独特、最珍贵,也最值得我们去保护和珍视的地方。