人工智能正在改变世界。这种改变的速度和深度,超出了很多人的预期。过去几年,人们讨论最多的是AI会替代哪些工作、取代哪些岗位。这种担忧有其道理,但可能抓住了次要问题,忽略了主要问题。

真正重要的不是机器替代人,而是人机如何协同。未来的人机共存时代,核心不在于某一种技术或算法,而在于对“智能本质是什么”的长期探索。这不是技术问题,而是关乎人类如何与自己的创造物相处的问题。

一、智能文明需要跨学科的基础

AI研究不是单纯的计算机科学。它涉及计算机视觉、模式识别、认知科学、神经科学、控制科学和数据科学等多个领域。这种跨学科的特点,决定了AI的发展必须打破传统的学科壁垒。

跨学科不能停留在表面。很多机构声称自己有多学科团队,但不同专业的人坐在一起开会,不等于真正的跨学科合作。真正有效的跨学科,需要深入到思想和精神层面。一个从事AI研究的人,除了掌握本专业知识,还需要了解认知科学、神经科学、计算机工具与平台等多方面内容。研究者本身也应当是“跨学科的”。

举一个例子。在新型冠状病毒的预测研究中,传统流行病模型和长短期记忆网络、自然语言处理技术结合起来,构建混合模型,可以提升预测准确性。这个例子说明,跨学科技术融合能够解决单一领域无法解决的问题。

更深层看,跨学科的意义不只在于知识的多样性,更在于它带来了批判性思维。科学发展的本质不是单纯的发现,而在于批判。就像生物多样性维持生命的延续,学科多样性也维持着学科的活力。缺乏批判精神的研究,无论技术多先进,都很难产生真正深刻的成果。

二、迈向认知与行动智能

未来五到十年,AI发展有六个方向值得关注。这些方向汇聚于一个共同目标:从“感知智能”走向“认知智能”和“行动智能”。

第一,多模态基础模型。目前的AI在感知层面做得不错,能识别图像、语音、文字,但要真正理解这些东西的含义,还需要进一步突破。多模态模型的目标是让机器从“看见”走向“理解”。

第二,具身智能与机器人。AI不能一直待在屏幕里。它需要进入物理世界,与现实环境互动。这就是具身智能的方向。机器人是具身智能的典型载体。

第三,构建世界模型。现在的深度学习模型更多是关联学习,而不是因果推理。世界模型的目标是引入因果推理与记忆机制,让AI的决策可以被解释。可解释性在医疗、金融、司法等高影响场景中尤为重要。

第四,人机协同智能。这个方向的核心逻辑不是“替代”,而是“增强”。AI不是为了取代人,而是为了增强人的能力。从替代逻辑走向增强逻辑,是一个重要的思路转变。

第五,高效智能计算。包括端侧AI、神经形态计算与新型视觉硬件。这些技术解决的是算力效率和部署成本问题。很多AI模型在云端运行良好,但到了边缘设备上就力不从心。

第六,人工智能驱动的科学研究与复杂系统智能。AI不只是工具,它可以成为科学发现的一部分。将AI应用于科学研究,推动公共卫生、能源、电网、交通、气候、城市治理等领域的变化,是这一方向的目标。

这六个方向指向一个重要趋势:把数据驱动模型与社会系统、科学发现、领域知识结合起来。未来五到十年,社会结构将因为AI而重组,就业形态也会发生显著变化。AI不仅改变物理世界,还重构人类的认知方式。同时,人类通过需求和约束塑造AI。这种双向塑造的结果,是一种全新的“智能文明”。

三、技术必须服务于人

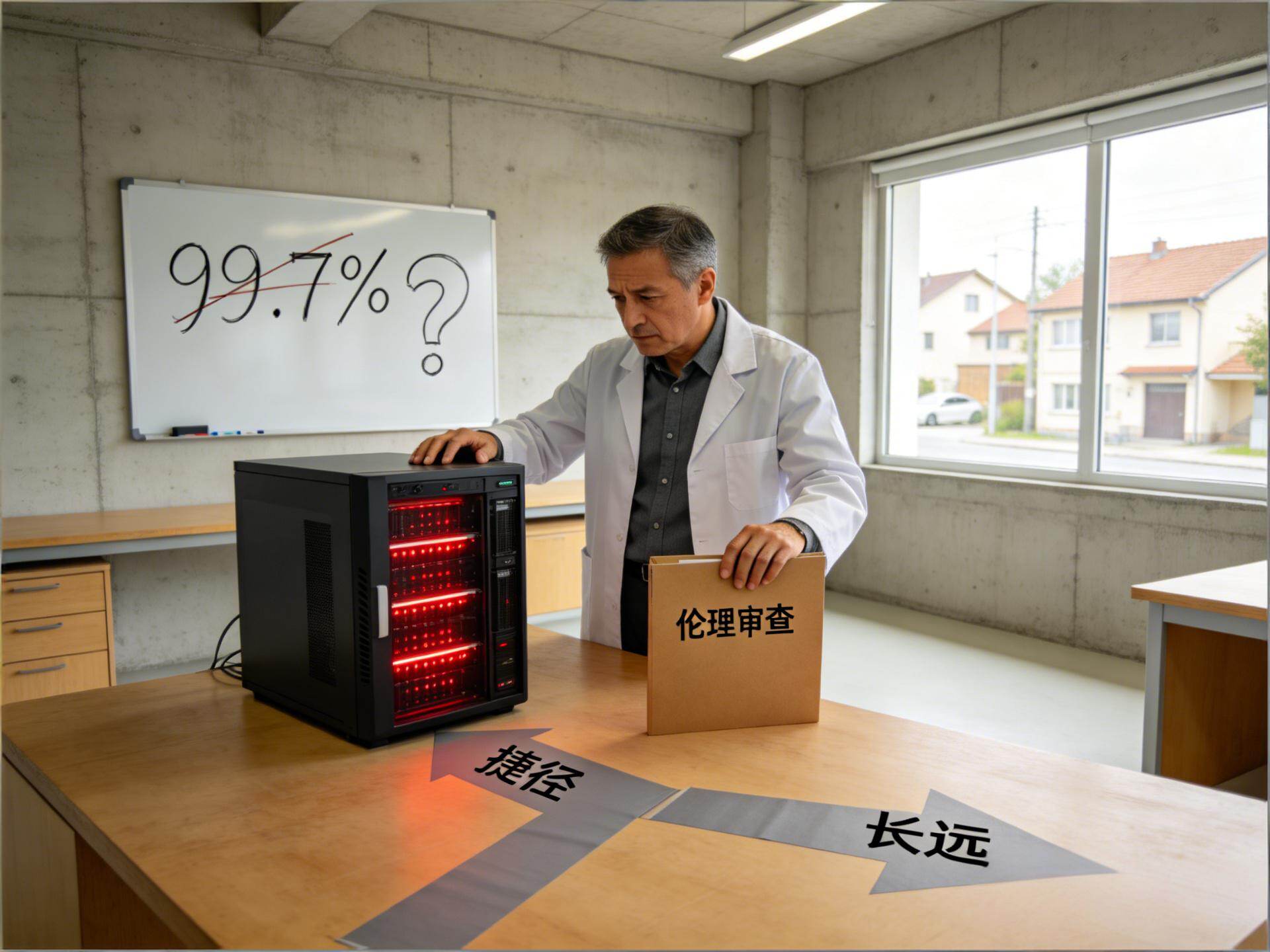

在AI伦理和安全受到越来越多关注的背景下,科技工作者面临一个基本问题:如何在追求技术创新的同时坚守底线?答案并不复杂:技术必须服务于人,不能脱离人、替代人,更不能压倒人。

有一个重要的区分需要做出:“能做”和“该做”不是一回事。当前AI面临的一个重要风险,就是把“技术可实现”等同于“应用可接受”。科技工作者不能只追求指标领先,而忽视技术可能带来的不利后果。

在科研实践中,有四条底线原则值得坚持。

第一,真实性底线。数据必须真实,实验必须可复现,结论不得夸大。这是科学研究的基本要求,但在竞争激烈的环境下,有时会被忽视。

第二,安全性底线。在高风险场景中,AI系统必须经过充分验证,并且确保人类参与最终判断。不能把决策权完全交给机器。

第三,可解释与可问责底线。越是高影响的场景,越需要明确系统为什么作出某个判断。同时,责任主体必须清晰。当系统出错时,不能只说“算法出了问题”。

第四,以人为中心底线。不能把“机器替代人”当作唯一目标。技术的目标应当是保障人的尊严和主体性。

风险规避不是单一环节能完成的。它需要从研究设计、训练评测、部署治理三个层面协同推进。研究阶段考虑伦理问题,比事后补救要有效得多。

一个值得强调的思路是“混合增强智能”。人机协作不是权宜之计,而是未来智能的基本形态。真正重要的突破不仅在于性能提升,更在于构建以人为本、安全可信、可持续演化的智能体系。

四、当前存在的问题

我国AI在基础理论、关键核心技术方面仍有短板,尤其在高端芯片、基础软件领域亟待突破。结合产业现实,主要存在五方面不足。

第一,底层硬件与软件生态薄弱,全栈自主性不足。很多AI系统建立在国外硬件和软件框架之上,存在安全隐患和供应链风险。

第二,原始理论创新滞后。应用强于理论的格局尚未根本改变。我们有很多应用层面的创新,但基础理论层面的突破相对较少。

第三,高质量数据与评测体系仍不完善。数据质量直接影响模型效果,评测体系则关系到模型的可靠性和可比性。

第四,基础软件与工具链自主性不足。编译器等基础软件层面的薄弱,限制了整体系统的优化空间。

第五,高可靠规模化应用能力薄弱。许多模型仍停留在演示阶段,从演示到真正规模化部署,中间有很长的路要走。

针对这些问题,一条可行的路径是“认知驱动+人机协同+视觉落地”。具体而言,从感知算法转向认知视觉系统突破;以混合增强智能推动高风险行业和极端环境的应用落地;加强认知科学、脑科学、物理学科与AI的深度融合;融合视觉、语言、知识与领域机理,发展面向复杂环境或任务的安全可信AI;推进“算法-芯片-系统”协同设计,以应用场景反向牵引自主软硬件生态的协同演进。

未来AI竞争的关键,在于能否率先整合感知、记忆、因果与协同,构建可信、可部署、自主可控的智能系统。

五、智能的本质

最后,有必要回到一个根本问题:智能是什么?智能并非某种突然而至的奇迹,而是世界演化出的一种新的认知结构。人类创造智能,用以扩展自身的感知与推理能力。与此同时,智能也反过来重塑人类的认知方式、决策逻辑与现实结构。二者形成持续反馈、相互塑造的关系。

未来人类和AI不是对立关系,而是共生与耦合的关系。理性被技术放大,也在边界处显现出局限。意义不由计算给出,仍需由人类选择。无论技术进步到什么程度,最终的价值判断和责任承担,仍然在人这一边。

这是迈向智能文明的基本前提。