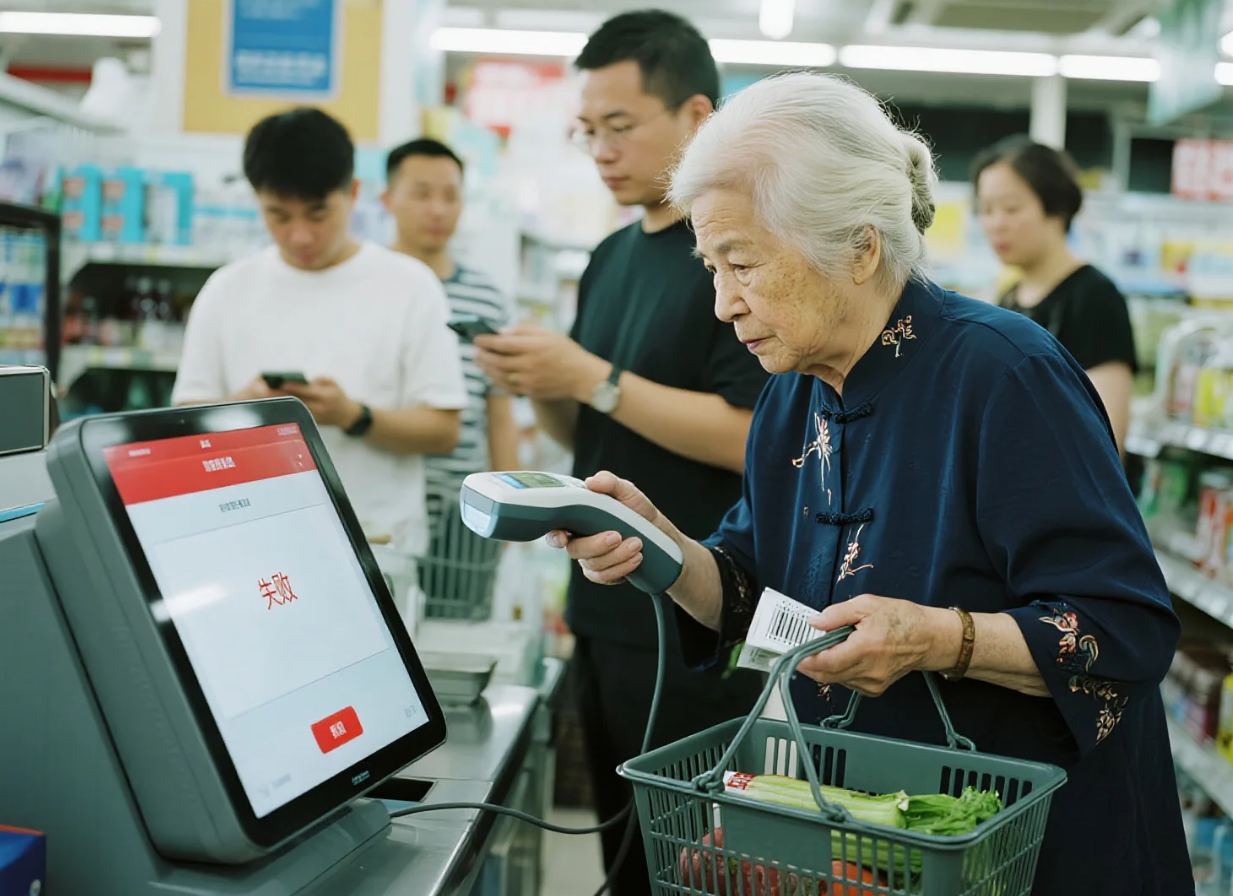

在超市自助结账柜台前,一位头发花白的老人反复扫描商品条码失败,面对屏幕上跳出的操作提示显得束手无策,身后渐渐排起长队——这常见的一幕,正是技术浪潮下部分人群面对AI时那份无措与疏离感的真实写照。尽管AI智能助手、算法推荐等服务早已融入日常生活,仍有人因陌生或忧虑而选择回避甚至排斥。

对AI的不信任并非毫无缘由:

对“失控”与“取代”的深层恐惧:媒体渲染“机器取代人类”的叙事,使不少人心头萦绕着职业被替代的阴影;更有甚者担忧未来某天AI可能挣脱人类约束。

对“黑箱”与“偏见”的天然警惕:AI内部决策逻辑的复杂性常被比喻为“黑箱”,人们无法清晰了解其判断依据。更令人忧心的是,若训练数据本身带有偏见,AI则可能无意识中延续甚至放大歧视。

对“冰冷机器”的情感疏离:在重视人情温度的服务场景中,人们往往更期待带着关切与理解的人际互动,而非程式化、略显疏离的AI回应。

对“数字鸿沟”的无奈:对部分长者或不熟悉数字工具者而言,操作界面复杂、学习门槛过高,构成了难以跨越的“使用鸿沟”。

化解之道:以信任为桥,以温度铺路

1.透明公开,让“黑箱”透光:努力提升算法可解释性,在重要决策领域(如信贷、医疗建议)清晰说明AI的推理依据与关键影响因素。例如,某金融APP在提供贷款评估时,会明确告知用户“收入稳定性”和“历史信用”在决策中所占权重。

2.以人为本,明确辅助定位:持续传递核心理念——AI的核心价值在于增强而非替代人类能力。在制造业,智能机器人承担了繁重高危的体力劳动,工人则转向需要经验判断、创新思考与柔性协调的岗位,人机协作效率显著提升。

3.筑牢隐私与伦理的堤坝:严格遵循数据最小化原则,清晰透明地告知用户数据用途并获取授权。建立强有力的独立监督机制,持续审查AI系统是否存在偏见或不公,及时修复问题。

4.设计包容,跨越使用鸿沟:界面设计应兼顾不同群体需求,提供语音交互、大字体显示、简洁操作流程等无障碍选项。社区图书馆定期开设“智能手机与AI助手应用”公益课,由志愿者手把手教学,让老人也能便捷享受数字生活。

5.展现温度,优化交互体验:投入情感计算研究,使AI交互能更敏锐地识别并回应用户情绪状态。当用户向智能客服表达强烈不满时,系统能识别其愤怒情绪,优先转接人工服务并附上诚挚道歉。

6.积极倾听,重视真实反馈:建立便捷的用户反馈渠道,对合理担忧与批评给予及时、透明的回应。某地图软件曾因算法推荐路线不合理收到大量投诉,官方快速响应,详细解释原因并承诺改进,赢得了用户谅解。

7.教育普及,消除认知迷雾:通过纪录片、社区讲座、中小学科普课堂等多元形式,用通俗语言和生动实例揭示AI基本原理、现有能力与明确边界,消除过度幻想和无端恐慌。

科技向前的每一步,都应在人心深处留下温暖的印记。AI不是冰冷的钢铁洪流,而是人类智慧精心锻造的工具,其终极使命在于扩展人类能力的边界,而非定义我们存在的价值。当我们以开放心态拥抱它,以审慎态度引导它,以包容理念设计它,便能逐步消融疑虑的坚冰。

人工智能时代,不应有被遗忘的角落。只有当技术真正服务于人的普遍福祉,努力填平数字鸿沟,尊重每一份情感需求,人机之间才能谱写出和谐共生的新乐章。未来并非人与机器的战场,而是智慧与善意交织的舞台——那里,我们始终是主角。